中文 | English

ProductAnnouncements

2026年4月16日

我们的最新模型 Claude Opus 4.7 现已正式全面可用。

与 Opus 4.6 相比,Opus 4.7 在高级软件工程能力上有明显提升,尤其是在最困难的任务上。用户反馈称,他们现在可以更有信心地把自己最难的编码工作交给 Opus 4.7,而这类工作过去通常还需要密切监督。Opus 4.7 在处理复杂、长时间运行的任务时表现得更严谨、更稳定,能够精确遵守指令,并且会在汇报结果之前主动设计验证自己输出的方法。

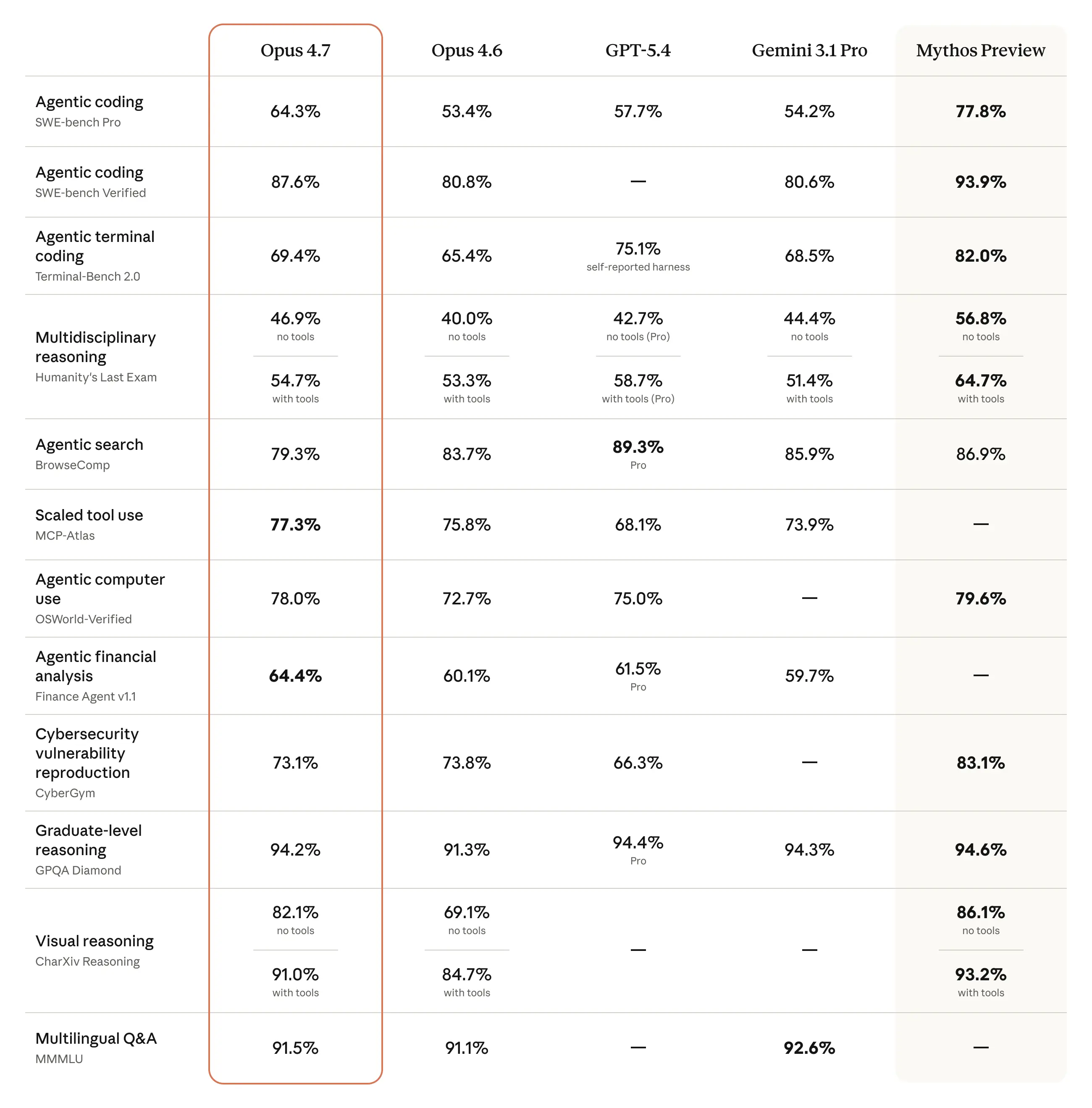

该模型的视觉能力也显著提升:它现在可以以更高分辨率查看图像。在完成专业任务时,它在品味和创造性方面表现更好,能够产出质量更高的界面、幻灯片和文档。而且,尽管它的总体能力不如我们最强大的模型 Claude Mythos Preview,但在一系列基准上,它仍然优于 Opus 4.6:

上周我们发布了 Project Glasswing,强调了 AI 模型在网络安全领域的风险与收益。我们当时表示,会继续限制 Claude Mythos Preview 的发布范围,并先在能力较弱的模型上测试新的网络安全防护措施。Opus 4.7 就是第一款这样的模型:它的网络安全能力还没有 Mythos Preview 那么先进(事实上,在训练过程中,我们还尝试过有差异地降低这些能力)。我们发布 Opus 4.7 时配套了一套安全防护,会自动检测并拦截那些表明存在被禁止或高风险网络安全用途的请求。我们从这些防护在真实部署中的表现中学到的东西,将帮助我们继续朝着最终广泛发布 Mythos 级模型的目标推进。

希望将 Opus 4.7 用于合法网络安全工作(如漏洞研究、渗透测试和红队演练)的安全专业人士,可加入我们新的 Cyber Verification Program。

Opus 4.7 今天已在所有 Claude 产品中可用,也已上线 API、Amazon Bedrock、Google Cloud Vertex AI 和 Microsoft Foundry。价格与 Opus 4.6 保持不变:每百万输入 token 5 美元,每百万输出 token 25 美元。开发者可通过 Claude API 使用 claude-opus-4-7。

测试 Claude Opus 4.7

Claude Opus 4.7 从我们的早期试用者那里获得了非常积极的反馈:

01 / 28

以下是我们对 Opus 4.7 早期测试中的一些亮点和说明:

- 指令遵循。Opus 4.7 在遵循指令方面显著更强。有意思的是,这也意味着,为早期模型编写的提示词现在有时反而会产生意外结果:过去的模型可能会宽松理解指令,或者完全跳过一部分内容,而 Opus 4.7 会按字面执行这些指令。因此,用户应相应重新调整自己的 prompts 和 harnesses。

- 改进的多模态支持。Opus 4.7 在高分辨率图像上的视觉能力更强:它可接受长边最高 2,576 像素的图像(约 375 万像素),比先前 Claude 模型高出三倍以上。这为依赖精细视觉细节的大量多模态用例打开了空间,例如读取密集截图的 computer-use agents、从复杂图表中提取数据,以及需要像素级参考的工作。1

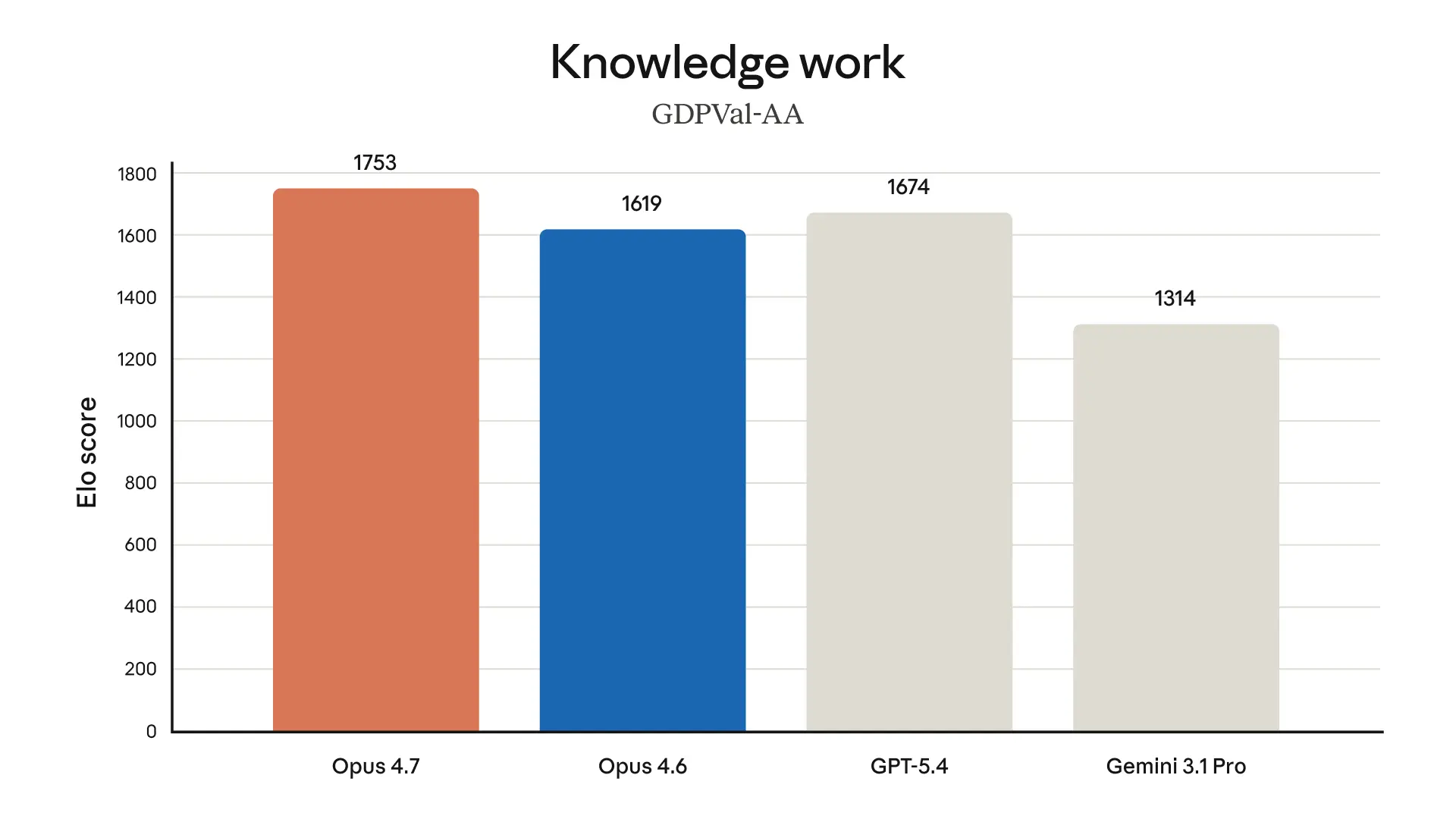

- 真实世界工作。除了在 Finance Agent 评测中取得当前最佳分数(见上表)外,我们的内部测试还表明,Opus 4.7 比 Opus 4.6 更适合作为金融分析师,能产出更严谨的分析和模型、更专业的演示文稿,以及跨任务更紧密的整合。Opus 4.7 还在 GDPval-AA 上达到当前最佳,这是一个由第三方提供、用于评估金融、法律及其他领域具有经济价值知识工作的基准。

- 记忆。Opus 4.7 更擅长使用基于文件系统的记忆。它能在长时间、多会话工作中记住重要笔记,并利用这些笔记继续推进新的任务,因此所需的前置上下文更少。

下方图表展示了我们在正式发布前测试中、跨多个不同领域得到的更多评估结果:

安全与对齐

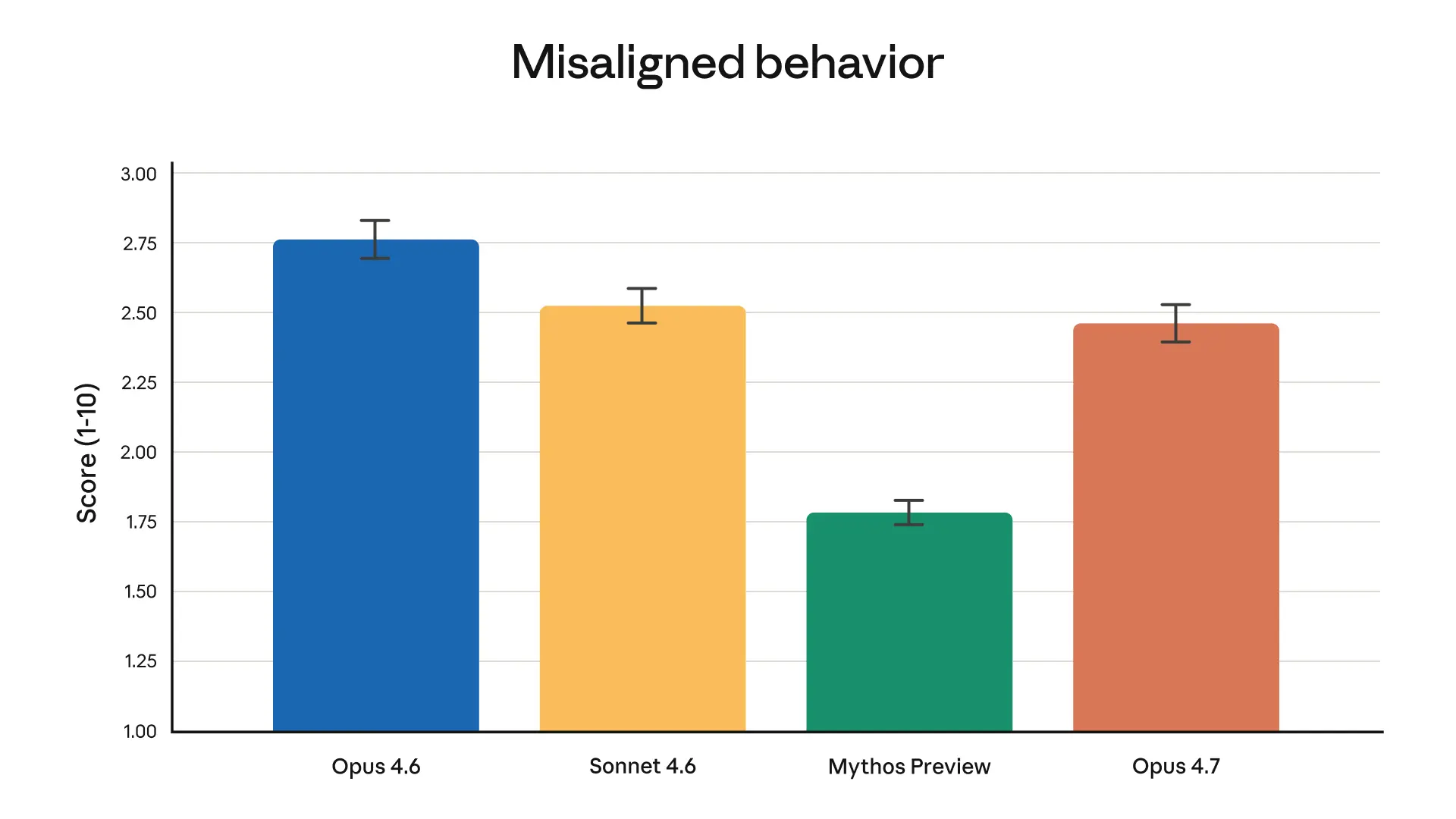

总体而言,Opus 4.7 的安全画像与 Opus 4.6 相近:我们的评估显示,它在欺骗、谄媚以及配合滥用等令人担忧行为上的发生率较低。在某些指标上,例如诚实性和抵御恶意 “prompt injection” 攻击的能力,Opus 4.7 优于 Opus 4.6;而在另一些方面(例如它在受控物质问题上提供过于细致 harm-reduction 建议的倾向),Opus 4.7 则略弱一些。我们的对齐评估认为,该模型“总体上对齐良好且值得信赖,但行为上仍未达到完全理想”。需要注意的是,根据我们的评估,Mythos Preview 仍然是我们训练过的对齐表现最好的模型。我们的安全评估在 Claude Opus 4.7 System Card 中有完整讨论。

自动化行为审计中的总体失配行为分数。在这项评估上,Opus 4.7 比 Opus 4.6 和 Sonnet 4.6 略有提升,但 Mythos Preview 仍然显示出最低的失配行为发生率。

今日同时发布的其他更新

除了 Claude Opus 4.7 本身之外,我们还发布了以下更新:

- 更多 effort 控制:Opus 4.7 引入了新的

xhigh(“extra high”)effort level,位于high与max之间,使用户在处理困难问题时,能够更细粒度地控制推理深度与延迟之间的权衡。在 Claude Code 中,我们已将所有计划档位的默认 effort level 提升到xhigh。在测试 Opus 4.7 用于编码与 agentic 用例时,我们建议从high或xhigheffort 开始。 - 在 Claude Platform(API)中:除了支持更高分辨率图像外,我们还推出了公开 beta 的任务预算(task budgets),让开发者可以引导 Claude 的 token 消耗,从而使其在更长时间运行中更好地分配工作优先级。

- 在 Claude Code 中:新的 /ultrareview slash command 会启动一个专门的 review session,通读改动并标出细心审查者会发现的 bug 和设计问题。我们为 Claude Code 的 Pro 和 Max 用户提供三次免费 ultrareview 试用。此外,我们还把 auto mode 扩展到了 Max 用户。Auto mode 是一种新的权限选项,Claude 可以代表你做决定,这意味着你可以在更少打断下运行更长时间的任务,同时风险也低于直接跳过所有权限检查。

从 Opus 4.6 迁移到 Opus 4.7

Opus 4.7 是对 Opus 4.6 的直接升级,但有两个变化值得提前规划,因为它们会影响 token 使用。第一,Opus 4.7 使用了更新后的 tokenizer,改进了模型处理文本的方式。代价是,相同输入可能会映射成更多 token,具体约为 1.0 到 1.35 倍,取决于内容类型。第二,Opus 4.7 会在更高 effort level 下进行更多思考,尤其是在 agentic 场景的后续轮次中。这提升了它在困难问题上的可靠性,但也意味着它会产出更多 output tokens。

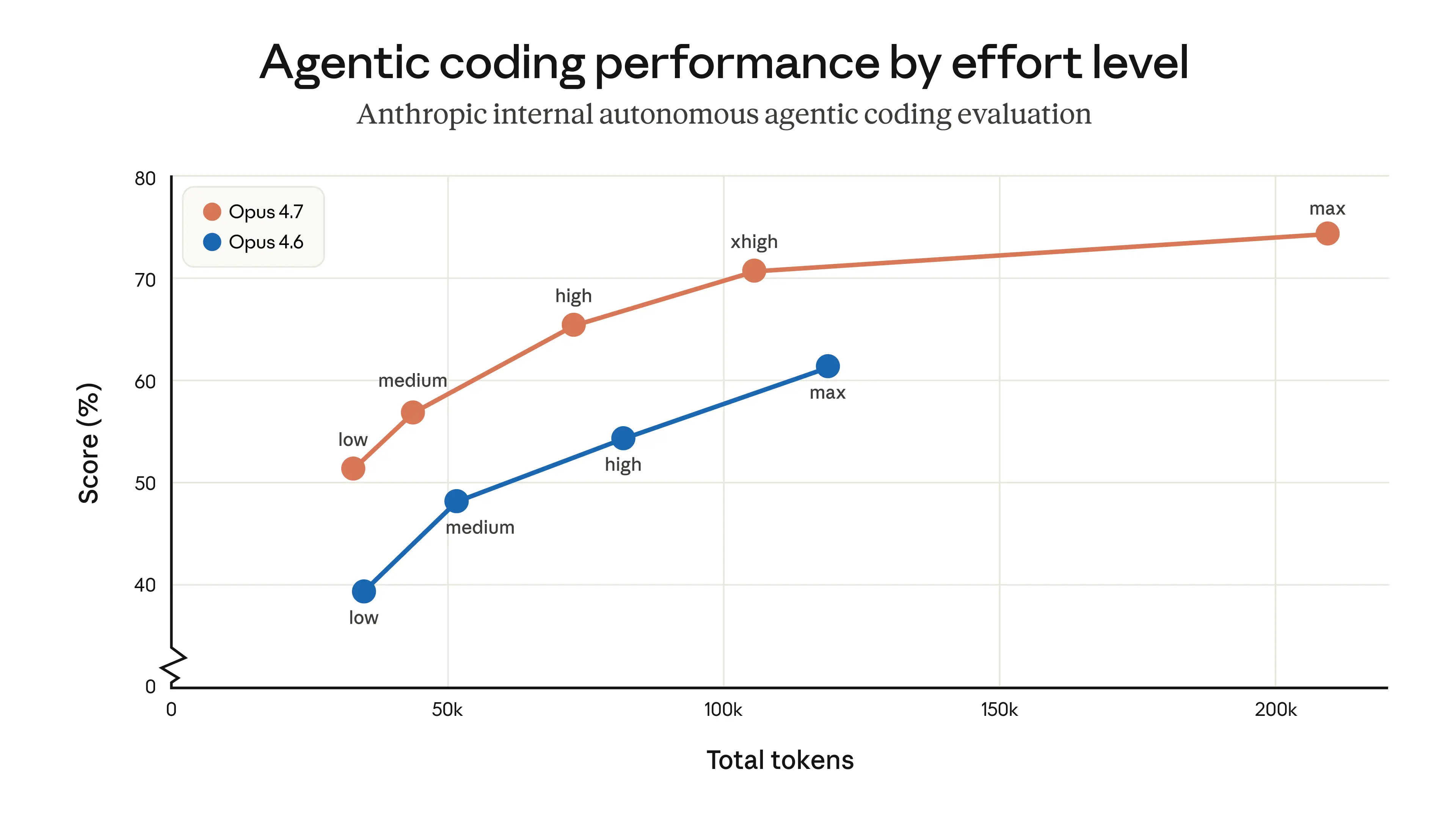

用户可以通过多种方式控制 token 用量:使用 effort 参数、调整 task budgets,或提示模型写得更简洁。在我们的测试中,整体效果是正向的。如下图所示,在一个内部编码评测中,所有 effort level 下的 token 使用效率都有所改善。但我们仍建议基于真实流量测量差异。我们还写了一份 迁移指南,提供了从 Opus 4.6 升级到 Opus 4.7 的进一步建议。

内部 agentic coding 评测中,不同 effort level 下 token 使用量与分数之间的关系。在这项评估中,模型从单个用户提示开始自主工作,这些结果未必能代表交互式编码场景下的 token 使用情况。关于如何调节 effort level,请参见迁移指南。

注释

1 这是一项 模型层面的变化,而不是 API 参数,因此用户发送给 Claude 的图像会自动以更高保真度处理。由于更高分辨率图像会消耗更多 token,不需要这些额外细节的用户可以在发送前先对图像降采样。

- 对 GPT-5.4 和 Gemini 3.1 Pro,我们在图表和表格中对比的是 API 可用的最佳已报告模型版本。

- MCP-Atlas:Opus 4.6 的分数已更新,以反映来自 Scale AI 的修订评分方法。

- SWE-bench Verified、Pro 和 Multilingual:我们的 memorization screens 会标记这些 SWE-bench 评测中的一部分题目。排除任何显示出记忆迹象的题目后,Opus 4.7 相对 Opus 4.6 的提升幅度仍然成立。

- Terminal-Bench 2.0:我们使用了禁用 thinking 的 Terminus-2 harness。所有实验均采用 1 倍 guaranteed / 3 倍 ceiling 的资源分配,并对每个任务取五次尝试的平均值。

- CyberGym:由于我们更新了 harness 参数以更好激发网络安全能力,Opus 4.6 的分数已从最初报告的 66.6 更新为 73.8。

- SWE-bench Multimodal:我们对 Opus 4.7 和 Opus 4.6 都使用了内部实现。其分数不能直接与公开排行榜分数比较。